Как выбрать сервер для ИИ в 2026 году: Архитектура, железо и расчет мощности

Краткие выводы:

- Выбор ИИ-сервера строго зависит от задачи: для обучения (Training) критичны пропускная способность интерконнекта (NVLink) и объем VRAM, для инференса (Inference) — низкая задержка и тензорная производительность (TOPS/TFLOPS).

- Графические процессоры (GPU) — основа ИИ. Выбор строится вокруг архитектуры ускорителей (например, NVIDIA Hopper/Blackwell или AMD Instinct) и их связи с центральным процессором.

- Проблема «бутылочного горлышка» (Bottleneck) хранилища решается исключительно массивами NVMe SSD с интерфейсом PCIe 5.0/6.0, способными непрерывно «кормить» GPU данными.

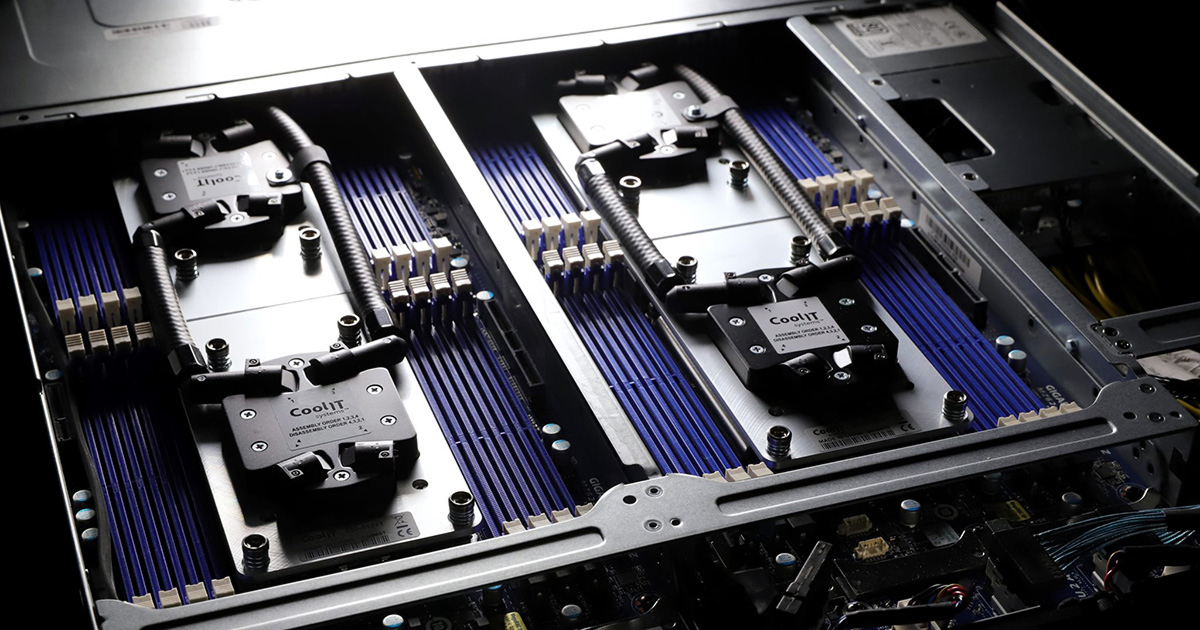

- Энергопотребление одного современного ИИ-сервера (на базе 8x GPU) может достигать 10-12 кВт, что требует внедрения систем жидкостного охлаждения (DLC).

1. Разделение задач: Обучение (Training) vs Инференс (Inference)

Прежде чем подбирать конфигурацию, необходимо определить тип ИИ-нагрузки. Сервер для создания нейросети кардинально отличается от сервера для ее эксплуатации.

- Обучение (Training): Процесс создания модели (LLM, генерация изображений). Требует колоссальных вычислительных мощностей, огромного объема видеопамяти (VRAM) для хранения весов и сверхбыстрой связи между несколькими GPU.

- Инференс (Inference): Использование уже обученной модели для ответов на запросы пользователей. Здесь важнее скорость отклика (Latency), энергоэффективность и возможность параллельной обработки тысяч мелких запросов. Для инференса часто достаточно серверов с 1–4 менее мощными GPU (например, NVIDIA L40S или RTX Ada Generation).

2. Ключевые компоненты ИИ-сервера

Архитектура ИИ-сервера строится вокруг графических ускорителей, но без правильного баланса остальных компонентов дорогие GPU будут простаивать в ожидании данных.

Графические ускорители (GPU)

GPU — это сердце искусственного интеллекта. В отличие от CPU с их десятками ядер, GPU имеют десятки тысяч мелких ядер, идеально подходящих для параллельных матричных вычислений.

- Объем VRAM: Для запуска открытых LLM (например, Llama 3 70B) требуется около 40-80 ГБ VRAM (в зависимости от квантования). Для обучения моделей с миллиардами параметров нужны серверы с суммарной памятью от 640 ГБ (например, сборки на 8x NVIDIA H100 80GB или B200).

- Интерконнект: Если в сервере больше 2-х GPU, связь через стандартный PCIe становится узким местом. Необходимо выбирать платформы с технологиями высокоскоростного обмена данными напрямую между видеокартами (NVIDIA NVLink / NVSwitch или AMD Infinity Fabric).

Центральный процессор (CPU)

В ИИ-сервере задача CPU — предварительная обработка данных (Data Preprocessing), оркестрация задач и маршрутизация сетевого трафика.

- Требования: Рекомендуется устанавливать два высокочастотных процессора (Intel Xeon Scalable 5-го/6-го поколения или AMD EPYC 4-го/5-го поколения) с большим количеством линий PCIe для прямого подключения NVMe дисков и сетевых адаптеров.

Оперативная память (RAM)

- Правило расчета: Объем системной оперативной памяти должен минимум в 2 раза превышать суммарный объем VRAM всех установленных видеокарт. Если в сервере установлено 8 GPU по 80 ГБ (всего 640 ГБ VRAM), вам потребуется от 1.5 до 2 ТБ системной памяти DDR5 с коррекцией ошибок (ECC).

Дисковая подсистема (Storage)

Машинное обучение требует непрерывного чтения гигантских датасетов. Использование HDD или медленных SATA SSD недопустимо — GPU будут простаивать на 90%.

- Стандарт: Исключительно серверные накопители U.2/U.3 или E1.S/E3.S NVMe SSD с поддержкой PCIe 5.0. Скорость чтения массива должна составлять от 30 до 60 ГБ/с.

3. Сравнительная таблица: Выбор GPU под задачи ИИ (Актуально на 2026 год)

| Модель GPU | Объем памяти (VRAM) | Основное назначение | Энергопотребление | Особенности |

|---|---|---|---|---|

| NVIDIA B200 / GB200 | 192 ГБ (HBM3e) | Обучение тяжелых LLM (GPT-уровня) | 1000 Вт+ | Экстремальная пропускная способность, жидкостное охлаждение. |

| NVIDIA H100 / H200 | 80 ГБ / 141 ГБ | Универсальный: Обучение и сложный Инференс | 700 Вт | Стандарт индустрии для дата-центров. |

| AMD Instinct MI300X | 192 ГБ | Обучение и Инференс крупных моделей | 750 Вт | Выгодная альтернатива с огромным буфером памяти. |

| NVIDIA L40S | 48 ГБ (GDDR6a) | Инференс, видеоаналитика, 3D-рендеринг | 350 Вт | Не требует NVLink, отлично встает в стандартные серверы PCIe. |

4. Сетевая инфраструктура (Networking)

Если мощности одного сервера не хватает, ИИ-кластеры объединяются в дата-центрах. Для синхронизации весов нейросети между серверами обычный 10G/25G Ethernet не подходит.

Вам потребуются адаптеры (SmartNIC / DPU), поддерживающие скорость 400GbE или 800GbE, а также технологии InfiniBand или RoCE v2 (RDMA over Converged Ethernet) для прямого доступа к памяти других серверов в обход CPU.

5. Охлаждение и питание: Физические ограничения дата-центра

Современный сервер формата 4U-8U, оснащенный восемью топовыми графическими ускорителями, потребляет от 8 до 12 киловатт (кВт) электроэнергии.

- Питание: Убедитесь, что стойка (Rack) в вашем дата-центре способна выдержать такую нагрузку на один юнит-блок. Потребуются усиленные блокы питания (от 3000 Вт каждый с резервированием N+N или N+1).

- Охлаждение: Классического воздушного охлаждения (воздух из холодного коридора) уже недостаточно для флагманских решений (уровня Blackwell). Рассматривайте серверные платформы с заводской интеграцией DLC (Direct Liquid Cooling) — прямого жидкостного охлаждения на чипы CPU и GPU.

Заключение

Выбор сервера для искусственного интеллекта — это поиск узких мест. Нет смысла покупать восемь самых дорогих графических ускорителей NVIDIA или AMD, если вы сэкономили на NVMe-хранилище или сетевых картах, которые не смогут обеспечить нужную скорость подачи данных. Для старта и тестов инференса обращайте внимание на серверы с 1-4 картами среднего сегмента (L40S / RTX 6000 Ada). Для обучения фундаметальных моделей рассматривайте только HGX-архитектуры с интерконнектом NVLink и запасом по охлаждению.